靳东观众被AI骗得措手不及,喜爱的心情遭受冲击

AI造假惊现!靳东粉丝爱恨交加,信任遭受考验

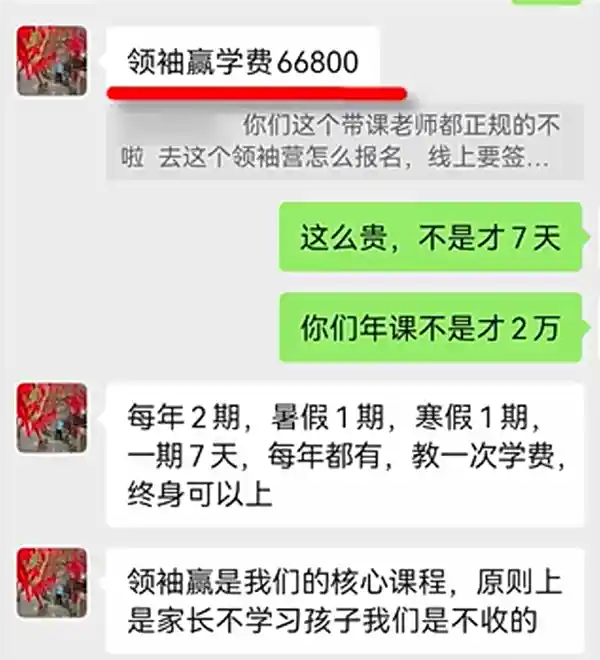

3月6日的消息显示,据媒体报道,全国政协委员靳东就AI换脸引发的诈骗问题作出了回应。

他说,一些观众因为AI换脸技术而对我不熟悉的影视剧产生了误解,这性质确实很恶劣。希望有关部门能够尽快出台更加完善的管理规定和技术规范,以防止这种现象继续发生,并保护观众的权益不受侵害。 这项技术的应用确实为娱乐产业带来了新的可能性,但同时也引发了隐私和伦理方面的问题。如何在鼓励创新的同时,确保公众不受误导,这是当前亟需解决的重要课题。因此,我认为需要行业内部以及社会各界共同参与,制定出既有利于技术发展又能有效监管的措施。

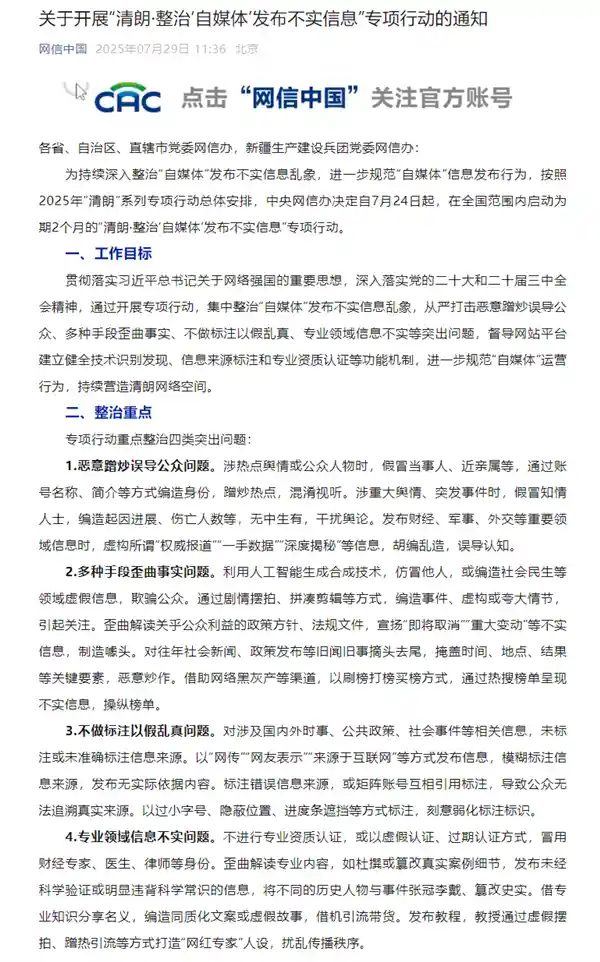

近年来,随着人工智能技术的进步,一些不法分子开始利用AI技术融合他人面孔和声音,制造非常逼真的合成图像来实施新型网络诈骗。

业内专家指出,“AI换脸”诈骗之所以能够成功,是因为在日常生活中,我们通常会通过面部来确认一个人的身份,这是一种很常见的习惯。“AI换脸”诈骗正是利用了我们这一习惯。

在判断视频的真实性时,我们确实可以采用一些技巧。例如,可以请求对方在视频通话中做出特定的手势动作,比如挥手。这样做的目的是为了干扰面部数据,让伪造的人脸更加容易暴露出来。因为在挥手的过程中,如果视频中的人脸是由深度伪造技术生成的,那么很可能会出现一些不自然的抖动或闪烁现象。通过这样的方法,我们可以更有效地辨别视频的真伪。 这种做法不仅能够提高我们对虚假信息的辨识能力,也提醒我们在接收网络信息时应保持谨慎态度。尤其是在当前技术快速发展的背景下,深度伪造技术的应用越来越广泛,这使得辨别真伪变得更加困难。因此,我们需要不断更新自己的知识和技术手段,以应对这些新的挑战。

另外,为了确保日常的信息安全,我们需要强化对人脸、声纹、指纹等生物特征数据的保护措施,并且要严格管理个人手机和电脑等终端设备的软硬件安全。切勿访问来源不明的网站,以防止病毒入侵。

人工智能最新资讯

2025-07-29 15:07:19

2025-07-29 15:02:04

2025-07-29 14:59:58

2025-07-29 14:55:05

2025-07-29 14:44:01

2025-07-29 14:42:47

2025-07-29 14:41:01

2025-07-29 14:39:44

2025-07-29 14:36:10

2025-07-29 14:35:51

2025-07-29 14:32:22

2025-07-29 14:32:15

2025-07-29 14:30:44

2025-07-29 14:30:08

2025-07-29 14:26:50

2025-07-29 14:26:23

2025-07-29 14:25:15

2025-07-29 14:24:07

2025-07-29 14:22:33

2025-07-29 14:20:13

2025-07-29 14:19:32

2025-07-29 14:17:51

2025-07-29 14:15:15

2025-07-29 14:13:33