AI教师:深度学习模型蒸馏,让智能教育更高效!

智慧教育革新:AI教师引领深度学习模型蒸馏时代!

原文标题:《模型蒸馏:让学霸老师带出学神学生》

当前,大模型已广泛应用于我们生活的各个领域,但随着应用场景的日益扩大,人们渐渐认识到大模型在运行效率和资源消耗上存在着一定的限制。

于是,一种创新的模型优化手段——模型蒸馏技术应运而生。这种技术通过使用一个大型复杂模型(教师模型)来指导一个小巧简洁模型(学生模型)的学习过程,从而在不牺牲预测性能的前提下显著减少了计算资源的消耗。它不仅为深度学习模型的部署提供了新的思路,还可能成为解决移动设备和物联网设备上运行复杂模型难题的关键。 这一技术的发展无疑为人工智能领域注入了新的活力,尤其对于那些受限于硬件条件的应用场景来说,模型蒸馏技术提供了一种更加高效且经济的解决方案。未来,随着研究的深入和技术的进步,我们有理由相信模型蒸馏将在更多领域得到广泛应用,推动整个行业向前发展。

那么,究竟什么是模型蒸馏呢?

今天,就让我们一同揭开它神秘的面纱,一探究竟。

模型蒸馏是一种知识迁移方法,目的是将大型且通常准确度较高的教师模型所获取的知识,传递给一个较为简单、结构更小的学生模型。

想象一下,你有一位超级学霸老师(我们称他为“教师模型”),他学识渊博,从天文到地理无所不包,解题速度也极快,但美中不足的是——他太过“庞大”!运行他需要超级计算机的支持,普通人的设备根本无法负担。

这时候,你希望培养一个“学神”学生(我们叫他“学生模型”),他不仅要像老师一样聪明,还得轻便灵活,能在手机、手表甚至冰箱上运行。

模型蒸馏,就是这个“学霸”带“学神”的过程。

传统的学生模型训练方式是“死记硬背”:给你一堆题目和标准答案(硬标签),你照着学就行了。但模型蒸馏不一样,它让学生模型学习教师模型的“解题思路”。

举个例子:

硬标签:题目“2+2=?”,答案是“4”。

软标签:教师模型不仅告诉你答案是“4”,还会告诉你“3”和“5”也有一定的可能性,只是概率很低。这种概率分布就是“软标签”。

通过软标签,学生模型不仅能学到答案,还能学到教师模型的“思考方式”,比如“2+2”更接近“4”而不是“3”或“5”。这样一来,学生模型的泛化能力更强,面对新题目时也能举一反三。

因此,模型蒸馏的过程可以简单分为三步:

1.拜师的过程首先需要训练一个超级强大的教师模型。这类模型通常规模庞大且结构复杂,但其卓越的性能却令人赞叹不已。 在这个过程中,我们不难发现人工智能领域对技术深度与广度的追求。尽管巨型模型的构建耗时费力,且需要大量的计算资源,但它们在提高模型性能方面的效果却是显而易见的。这些超级强大的教师模型不仅能够提供更准确的学习样本,还能为后续的学生模型提供更为精细的知识框架。这无疑推动了整个AI领域的进步,同时也向我们展示了科技发展背后所付出的巨大努力。

2.教师模型通过对训练数据生成软标签,学生模型则通过模仿这些软标签来提升自身的性能。这种知识蒸馏的过程不仅提高了学生模型的学习效率,还使它们在处理复杂任务时表现得更加出色。这种方法的应用前景广阔,尤其是在需要快速部署且资源有限的环境中,能够显著提高模型的准确性和灵活性。

3.出师:学生模型最终蜕变为轻量级且性能与教师模型相当的“学霸”。

举个形象的例子:

教师模型就像是一个围棋大师,他能看到每一步棋的无数种可能性。

学生模型则如同一位围棋少年,他通过对大师棋路的深入学习与模仿,逐步掌握了高深的棋艺。这种学习方式不仅展示了人工智能在理解和吸收复杂知识方面的潜力,同时也揭示了传统教学方法在培养专业技能时的重要作用。通过这种方式,我们不仅可以期待未来在围棋领域取得更多突破,还能探索出更多跨领域的应用可能,为教育和科技的发展提供新的思路。

最终,这位少年不仅能在棋盘上展现出大师级的棋艺,还能够利用手机与世界各地的人进行对弈。这充分展示了现代科技为年轻一代带来的机遇,让他们能够在更广阔的舞台上展示自己的才华。同时,这也反映出当代青少年在掌握传统技艺的同时,也能很好地适应和运用新技术。这种结合传统与现代的能力,无疑将为他们未来的发展开辟更多可能性。

模型蒸馏之所以火,主要是因为它有以下几个逆天优势:

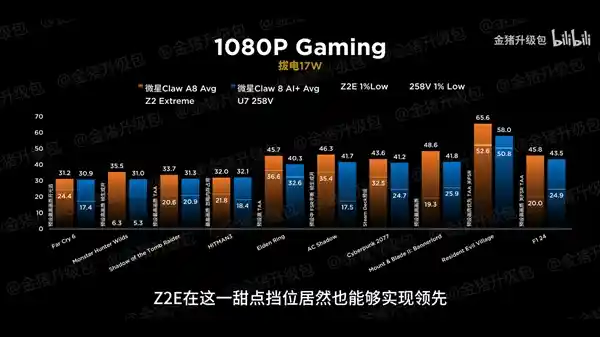

模型压缩:学生模型远小于教师模型,适用于运行资源较为有限的设备上。

性能不打折:学生模型的性能可以接近甚至超过教师模型。

泛化能力强:软标签提供了更多的信息,使得学生模型在处理新数据时能够表现出更好的适应性和准确性。这种技术的应用不仅提高了机器学习模型的学习效率,还增强了它们在复杂环境下的泛化能力。通过利用软标签,模型可以更好地理解数据背后的细微差别,从而在实际应用中做出更为精准的预测和决策。这一进步对于推动人工智能领域的发展具有重要意义,同时也为未来的研究开辟了新的方向。

举个例子,BERT模型想必大家都很熟悉。它的简化版DistilBERT,体积仅相当于BERT的40%,但性能却能接近BERT的97%!这正是模型蒸馏技术的神奇之处。

这些魅力使得模型蒸馏的应用场景非常广泛,几乎涵盖了 AI 的各个领域:

自然语言处理:如 DistilBERT、TinyBERT,让手机也能跑 NLP 模型。

计算机视觉:将大型卷积神经网络蒸馏为轻量级模型,用于手机拍照、人脸识别等。

边缘计算:在智能家居和自动驾驶等领域,模型蒸馏技术使得AI能够在低功耗设备上高效运行。

举个例子,你手机上的语音助手为何能够理解你说的话?这背后或许就依靠一个精悍而强大的蒸馏模型在幕后运作。

随着人工智能技术的不断进步,模型蒸馏的作用将愈发显著。这不仅有助于打造更小巧、更迅捷的AI模型,也让AI技术更加普及化。将来,我们或许会见到更多体积虽小却效能卓越的AI模型融入日常生活。

模型蒸馏,这实际上是一种“知识传递”的技术,它使得复杂的AI模型得以精简,同时仍然保持出色的性能。无论是在学术研究领域还是在工业应用中,模型蒸馏都发挥着越来越关键的作用。

本文来自微信公众号:中兴文档(ID:ztedoc)

人工智能最新资讯

2025-08-04 15:56:43

2025-08-04 15:49:26

2025-08-04 15:36:51

2025-08-04 15:35:41

2025-08-04 15:34:15

2025-08-04 15:33:03

2025-08-04 15:28:40

2025-08-04 15:25:10

2025-08-04 15:24:56

2025-08-04 15:16:19

2025-08-04 15:12:44

2025-08-04 15:11:41

2025-08-04 15:10:37

2025-08-04 15:10:13

2025-08-04 15:04:23

2025-08-04 15:03:13

2025-08-04 15:02:05

2025-08-04 15:00:04

2025-08-04 14:59:38

2025-08-04 14:57:57

2025-08-04 14:55:16

2025-08-04 14:53:07

2025-08-04 14:50:06

2025-08-04 14:49:51