发布日期:2025-03-19 19:34:05

《中国信通院发起AI大模型幻觉评测,五大维度全面揭秘智能新挑战》

幻觉之困:解密AI大模型的智能迷局

3月19日消息,据中国信通院官方微信公众号透露,为了深入了解大模型的幻觉现象,促进大模型技术的实际应用,中国信息通信研究院人工智能研究所结合此前的AISafetyBenchmark测评项目,启动了大模型幻觉测试工作。

大模型幻觉(AI Hallucination)指的是模型在输出信息或解答问题时,生成了表面上看似有逻辑但实际与用户输入不符(忠实性幻觉),或是与客观事实相悖(事实性幻觉)的结果。随着这类模型在医疗、金融等重要领域的深入应用,其可能引发的风险也逐渐显现,并受到行业的高度关注。

本轮幻觉测试工作将以大语言模型为测试对象,涵盖了事实性幻觉和忠实性幻觉两种幻觉类型,具体测评体系如下:

测试数据涵盖7000多条中文样本,测试形式涵盖与忠实性幻觉检测相关的信息抽取和知识推理两种题型,以及针对事实性幻觉检测的事实判别题型。整体内容涉及人文科学、社会科学、自然科学、应用科学和形式科学五大领域。

中国信通院面向各相关企业发出邀请,携手开展模型测评工作,共同促进大模型的安全应用与发展。

人工智能最新资讯

算法黑箱谁来揭开?青岛律师起诉腾讯《王者荣耀》匹配机制,8月12日法院开庭

2025-07-26 12:29:25

小米16 Ultra提前登场:徕卡深度联名,直屏回归引爆期待

2025-07-26 11:31:19

Redmi 15 渲染图曝光:骁龙6s Gen 3加持,三色美学惊艳亮相

2025-07-26 11:24:52

拒绝Win11 Recall:AdGuard支持Brave反击微软隐私策略

2025-07-26 11:05:46

机械师L9X1电竞鼠标来袭:PAR2862主控+双8KHz回报率,开启轻量级无线新体验

2025-07-26 10:23:37

极氪首款混动车型9X即将亮相成都车展,纯电路线暂未公布

2025-07-26 10:23:03

智驾测试惨败!懂车帝曝光华为等国产系统真实水平

2025-07-26 10:22:44

苹果新专利曝光:轻量MacBook Pro来袭,风扇底座革新引领高效静音革命

2025-07-26 10:18:42

国补重启!第三批资金重磅到账

2025-07-26 10:18:41

罗马仕充电宝口袋爆燃致男子三度烧伤,非召回批次隐患引关注

2025-07-26 10:16:31

苹果iOS 26公测版来袭:iPhone 11后机型抢先体验未来系统新纪元

2025-07-26 10:12:33

三星移动总裁:欢迎苹果入局折叠屏,竞争将推动行业进步

2025-07-26 10:12:30

超长期特别国债再加码 690亿助力以旧换新热潮

2025-07-26 10:12:00

男子裸体现身谷歌街景遭曝光,获赔9万元引发热议

2025-07-26 10:11:24

三星强化漏洞管控,One UI泄密渠道或将大幅受限

2025-07-25 09:21:14

小米AI物联网平台亮相央视!雷军:五年培育五万新人才

2025-07-25 09:20:36

华为辅助驾驶再登顶,特斯拉黯然失色?

2025-07-25 09:00:17

GPT-5即将来袭?OpenAI重磅官宣8月初震撼发布

2025-07-25 08:52:01

英特尔首尝败绩:14A若难获大客户认可,或终止研发之路

2025-07-25 08:42:47

纳德拉痛下狠手:微软9000人裁员背后,AI转型风暴来袭

2025-07-25 08:41:38

《天外世界2》实体光盘海外开订,Xbox玩家迎来数字与实体双选择时代

2025-07-25 08:24:04

39岁富豪CEO惨遭6吨大象连续踩踏30秒,网友:地狱级悲剧!

2025-07-25 08:18:03

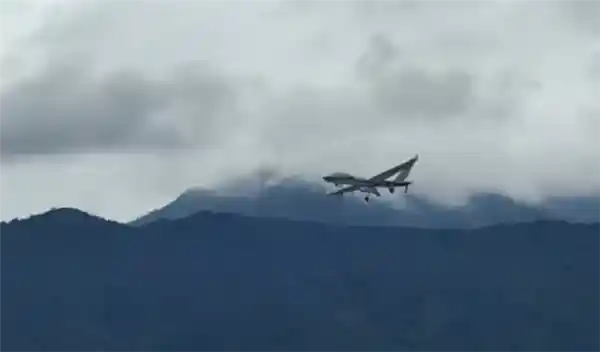

翼龙出击!全国首架无人机成功执行台风预警侦察任务

2025-07-25 08:02:51

理想高管晒图称i8遭恶意抹黑,乐道总裁强硬回应:建议报警处理

2025-07-25 07:57:04

砸10亿布局餐饮?刘强东再掀外卖革命